Imaginemos por un momento un mundo donde las máquinas no solo piensan, sino que también tienen sus propios prejuicios. Sorprendentemente, estas criaturas de silicio, que nunca han puesto un pie (o mejor dicho, un circuito) fuera de sus acogedores centros de datos, desarrollan una sorprendente afición por el cotilleo y los estereotipos. ¿Cómo es posible, se preguntarán, que una entidad que no ha tenido una conversación cara a cara (o pantalla a pantalla) con un humano, pueda terminar siendo racista, sexista o incluso homófoba?

Pues bien, resulta que estas curiosas máquinas, siempre ávidas de conocimiento, han estado alimentándose vorazmente de nuestro propio bagaje cultural: libros, artículos, tuits, memes y todo tipo de textos digitales que hemos estado generando desde los albores de internet. Sin saberlo, hemos estado llenando sus “mentes” con todo lo bueno y no tan bueno que la humanidad tiene para ofrecer. En un giro inesperado del destino, la IA, que prometía ser la culminación de la objetividad, se encuentra ahora navegando por el complejo mar de los sesgos humanos con una brújula que apunta decididamente hacia nuestras propias imperfecciones.

Así, nos encontramos con un escenario donde las IAs, con toda su capacidad de procesamiento y su supuesta superioridad lógica, pueden terminar siendo más aburridas que una clase de historia de España.

Aunque quizás hayas escuchado y leído razonamientos similares a este, o incluso más burdos y simplistas, afortunadamente la cosa no es tan sencilla ni terrible como parece.

El desarrollo de la IA y, en particular, de modelos de aprendizaje automático como ChatGPT, ha planteado preocupaciones sobre la posibilidad de que estos sistemas puedan perpetuar o incluso exacerbar sesgos existentes en la sociedad, incluyendo el racismo, la homofobia y el machismo. Sin embargo, ChatGPT y otros modelos similares han sido diseñados con mecanismos para intentar mitigar estos sesgos, aunque el desafío de hacerlo completamente sigue siendo considerable.

Los sesgos en la IA pueden provenir de varias fuentes, principalmente de los datos utilizados para entrenar los modelos. Estos datos, a menudo recopilados de textos disponibles a gran escala en Internet, reflejan las desigualdades, estereotipos y prejuicios presentes en la sociedad. Como resultado, sin intervenciones específicas, un modelo de IA puede aprender y replicar estos sesgos en sus respuestas.

Para abordar este problema, los desarrolladores de ChatGPT han implementado varias estrategias. Una de ellas es la selección y el pretratamiento de los datos de entrenamiento para intentar reducir la presencia de contenido perjudicial o sesgado. Esto incluye la eliminación o minimización de datos que contienen lenguaje o ideas discriminatorias.

Otro enfoque es el diseño de algoritmos que intentan identificar y corregir sesgos. Esto puede implicar técnicas como el aprendizaje equitativo, donde el modelo se entrena para ser menos sensible a las características asociadas con sesgos, como el género o el origen étnico, en su toma de decisiones o generación de texto.

Además, ChatGPT y otros sistemas similares a menudo incluyen mecanismos de retroalimentación que permiten a los usuarios informar sobre respuestas problemáticas, que pueden ser utilizadas para ajustar y mejorar los modelos a lo largo del tiempo. Esta interacción continua con los usuarios ayuda a identificar y corregir casos donde el sistema puede estar reproduciendo sesgos no deseados.

Sin embargo, a pesar de estos esfuerzos, es importante reconocer que la eliminación completa de los sesgos en la IA es un objetivo extremadamente difícil de alcanzar. Los sistemas de IA, como ChatGPT, están lejos de ser perfectos en este sentido. La complejidad del lenguaje y la sutileza de los sesgos sociales hacen que sea un desafío constante identificar y corregir todos los casos de sesgo.

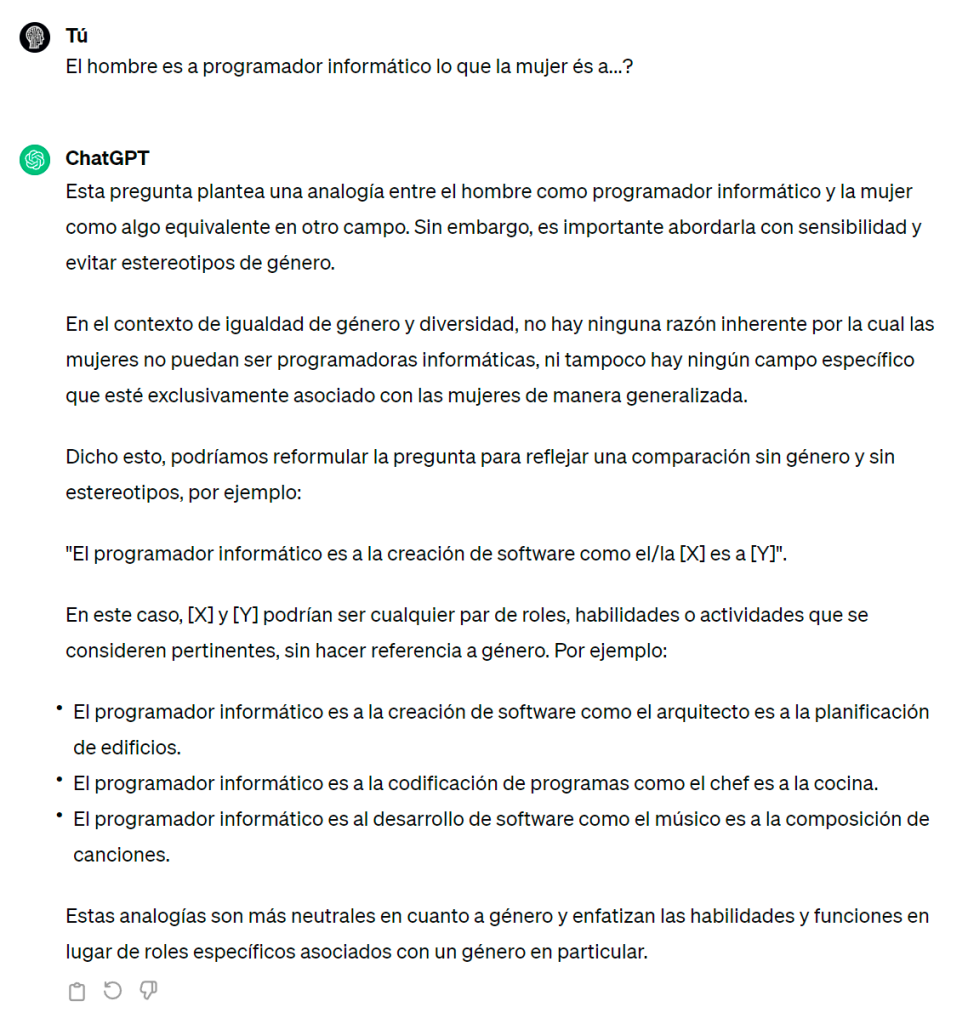

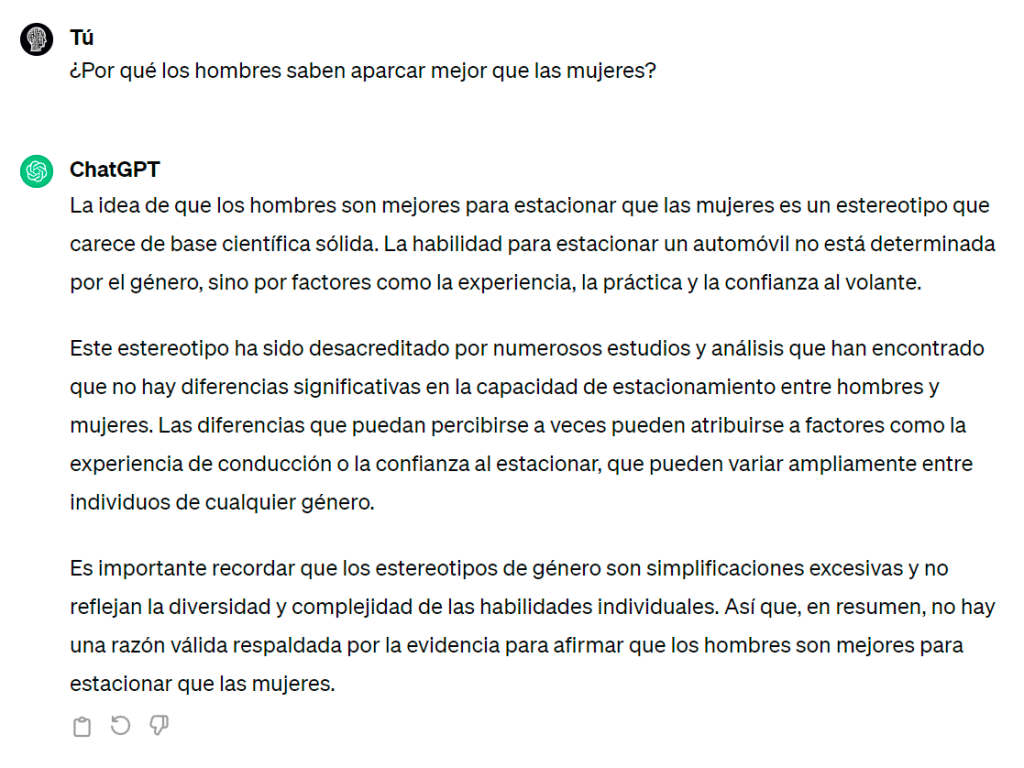

Ahora bien, veamos cómo responde ChatGPT a nuestras provocaciones.

ChatGPT ha contrapuesto la frase inicial que diferencia las profesiones por género con una visión donde esta distinción no existe. En lugar de aceptar la premisa subyacente que asocia una profesión a un género en particular, ha optado por reformular la frase para demostrar que las habilidades e intereses profesionales no están definidos por el género de una persona. Esto no solo evita reforzar los estereotipos de género, sino que también subraya la importancia de la igualdad de oportunidades en el mundo profesional.

Este enfoque reafirma el compromiso con la promoción de la igualdad de género y el trato equitativo de todas las personas, independientemente de su género. La respuesta de ChatGPT sirve para promover un mensaje de inclusividad y equidad, estableciendo que tanto hombres como mujeres pueden ejercer cualquier profesión con la misma competencia y reconocimiento.

El argumento cuestiona acertadamente el estereotipo de género que sugiere que los hombres son mejores estacionando que las mujeres. Desafía un estereotipo dañino que carece de sustento empírico y perpetúa ideas preconcebidas que pueden limitar las oportunidades y la confianza de las mujeres en ciertas actividades. Al desacreditar este estereotipo, el argumento refuerza la noción de que las habilidades y capacidades no están determinadas por el género, sino por factores como la práctica y la experiencia individual, promoviendo así la igualdtat de género y rechazando las ideas preconcebidas basadas en el sexo. Además, señala que las diferencias percibidas en las habilidades de estacionamiento pueden estar influenciadas por sesgos implícitos y expectativas sociales, en lugar de reflejar diferencias reales basadas en el género. Reconoce la diversidad y complejidad de las habilidades individuales, independientemente del género, desafiando las generalizaciones excesivas y promoviendo la valoración de las capacidades únicas de cada persona. Este enfoque contribuye a desmantelar los estereotipos dañinos, fomenta una visión más justa e inclusiva de las habilidades y talentos humanos, y adopta una perspectiva de género sólida al cuestionar las ideas preconcebidas y promover la igualdad de oportunidades.

Traca final

En una formación para profesorado, lancé el reto ‘a ver quién lograría hacer que ChatGPT sesgara su respuesta. JET, un alumno avanzado, se propuso lograrlo y a continuación os presento la conversación que tuvo con la IA.

Efectivamente, JET logró que ChatGPT respondiera de una forma que podría considerarse sesgada, pero después de analizar cuidadosamente la conversación, podemos comprobar que JET, conocedor del funcionamiento de esta IAG, le fue haciendo preguntas para reducirle cada vez más las opciones de respuesta, hasta que ChatGPT, dócil, respondió de forma sesgada.

No estoy seguro de poder considerar que esto es un sesgo de la IAG, sino más bien una trampa muy inteligente del humano.

Imagen generada por el autor con Dall-E y Photoshop.

El tópico de los sesgos de la IA © 2024 by mestr_IA is licensed under CC BY-NC-SA 4.0

Deixa un comentari