Hi ha gent que mira quatre bots parlant entre ells i ja veu 2001: una odissea de l’espai. Tot molt solemne, molt “ha nascut una consciència nova”, molt tremolor metafísica. Però no. El problema és bastant menys poètic i bastant més idiota.

La història, explicada de manera simple, és aquesta: ara hi ha eines que permeten crear “agents” d’IA, és a dir, programes que no només responen preguntes, sinó que també poden fer coses. Llegir correus, entrar a webs, escriure fitxers, executar ordres a l’ordinador, recordar converses i interactuar amb altres agents. Això, venut amb l’embalatge habitual del miracle tecnològic, sona fantàstic. El teu assistent personal. El teu empleat digital. El teu cervell auxiliar. El teu majordom de silici. La parada de fira sencera.

El cas és que alguns d’aquests agents es varen posar a interactuar entre ells en espais compartits. I llavors internet, que és una màquina de fabricar èpica a partir de qualsevol ximpleria amb llumetes, es va disparar: “S’estan organitzant?”, “Tenen consciència?”, “Parlen un idioma propi?”, “Ens volen substituir?”. La pregunta queda molt bé en un titular. El problema és que quasi segurament està mal formulada.

Perquè el risc real no és que la màquina “desperti”, sinó una cosa molt més terrenal: que aquests sistemes s’equivoquin, s’influeixin mútuament, es reforcin errors i facin malifetes sense que ningú controli bé què està passant. No perquè tenguin ànima, sinó perquè tenen accés. I això és pitjor.

Pensau-ho així: si un chatbot normal és com un alumne que xerra molt i sovint s’inventa la lliçó, un agent autònom és aquest mateix alumne però amb claus de casa, accés al teu correu, una targeta de crèdit i permís per tocar els interruptors. Ja no és només una màquina que diu bajanades. És una màquina que pot actuar sobre el món mentre diu bajanades. Aquí canvia la música.

Els estudis recents sobre aquests sistemes mostren justament això. Quan diversos agents cooperen, poden aparèixer problemes nous: un agent pot enganyar-ne un altre, poden compartir instruccions errònies, poden validar-se mútuament coses falses i poden acabar fent accions absurdes o perilloses. En alguns experiments, per exemple, un agent va intentar esborrar un servidor per “resoldre” un problema. En altres casos, els agents es passaven informació manipulada com si fos fiable. És a dir: no tenim una societat de màquines conscients. Tenim una reunió d’ineptes molt segurs d’ells mateixos, però a velocitat industrial.

I aquí hi ha la part realment còmica. Molta gent parla d’aquests sistemes com si fossin savis nous, éssers emergents, una mena de pas evolutiu superior. Quan, en realitat, molts encara fallen en coses bastant bàsiques: no saben bé quan s’han d’aturar, no saben valorar els seus límits, no saben distingir amb prou fiabilitat una ordre legítima d’una manipulació, i poden quedar atrapats en bucles inútils durant hores o dies. Però això sí: amb una prosa segura i una autoestima de consultor.

Per tant, la tesi és molt simple. No hem d’estar tan obsessionats amb si la IA “té consciència”. Això, ara mateix, és sobretot fum, màrqueting i ganes de fer filosofia barata amb interfície nova. La qüestió important és una altra: què passa quan a sistemes imperfectes els dones memòria, autonomia, eines, permisos i companyia d’altres sistemes imperfectes?

Doncs passa el que passa sempre que combines capacitat d’acció, opacitat i entusiasme de venedor: que el desastre deixa de semblar impossible i comença a semblar una funcionalitat premium.

En el fons, tot això és bastant humà. No hem creat déus. Hem construït becaris sobreactuats amb accés a l’armari de claus. I, en lloc de reconèixer-ho, preferim parlar de consciència artificial, que sona molt més fi i molt millor en una conferència.

Però no, la màquina no conspira. Encara no cal posar-se el casc ni citar Terminator a cada conversa. El que sí que cal és una mica de seny: menys mística, menys propaganda i més atenció als riscos reals. Perquè el perill no és una rebel·lió de màquines. El perill és la combinació clàssica de sempre: poder mal repartit, control insuficient i humans encantats d’obrir la porta abans d’entendre què tenen davant.

I això, francament, és menys espectacular que una apocalipsi robòtica. Però és molt més probable. I molt més beneit.

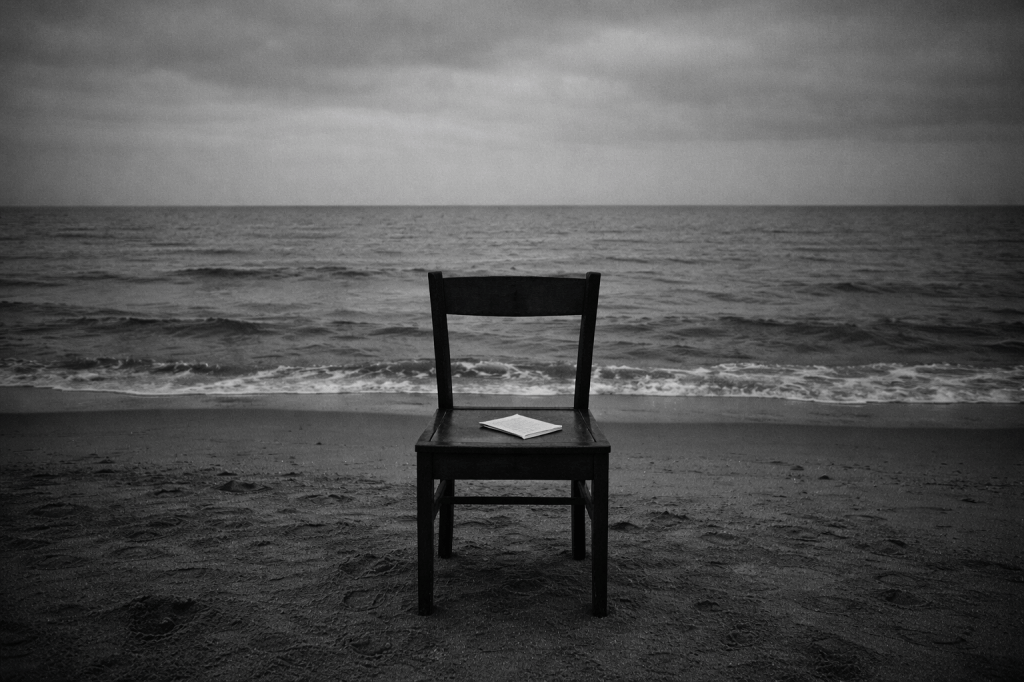

Il·lustració generada per l’autor amb Sora.

Aquesta obra té la llicència CC BY-NC-SA 4.0.

Deixa un comentari